Das Internet ist zweifellos eine Erfolgsgeschichte. Doch wie und wieso es funktioniert, das wissen die wenigsten. Dabei funktioniert es sehr ähnlich wie die Schweiz. Eine kurze Geschichte des Internets und wieso es so geworden ist, wie es ist. Und was sich daran noch ändern wird.

Klar, jeder weiss, was das Internet ist: Das Kabel und das andere Zeugs das hinter dem eigenen Heimrouter hängt. Und meistens funktioniert es. Mehr muss man ja nicht wissen, oder?

Das Internet ist regelmässig Thema bei DNIP oder in der Politik. Oder wenn der schöne Fernsehabend oder die wichtige Videokonferenz jetzt gerade nur stottert und abbricht. Der Blick in die Entwicklung des Internet ist auch ein Blick hinter die Kulissen. Und ein besseres Verständnis. Und dabei werden wir auch auf viele Analogien zur Schweiz stossen, wie Rütlischwur, Stabilität, Föderalismus und die Wichtigkeit von Tunnels.

Eben, so kompliziert kann das ja gar nicht sein. Also rein in die Materie!

Lea Schönberger hat vor ein paar Tagen den Artikel «Filtern, sperren, abschalten: Wie sich das Internet kontrollieren lässt» publiziert, in dem sie auch Router und Routing im Internet einführt. Perfekt, um sich mit der Materie bekannt zu machen, falls sie neu ist.

Inhalte

ToggleVor dem Internet

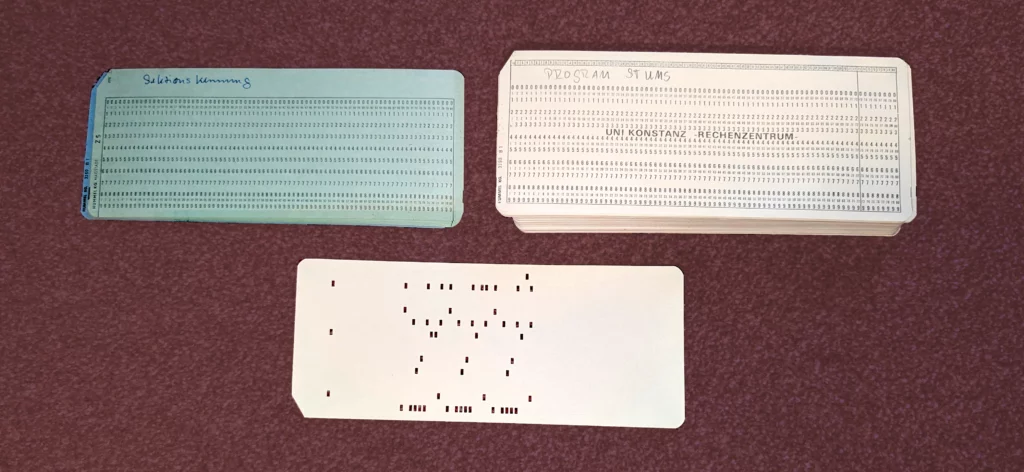

Wenn man in den 1960ern und 70ern mit einem Programm etwas berechnen wollte, musste man zuerst einmal das Glück haben, bei einer Firma oder einer Uni zu arbeiten, die einen Computer hatte.

Anfänglich brachte man dazu zwei Stapel Lochkarten zu den Wächtern dieses Computers, den sogenannten Operateuren. Ein Stapel enthielt das Programm, Quellcodezeile für Quellcodezeile; der andere Stapel die Daten, die man damit bearbeiten wollte. Am folgenden Tag konnte man nachschauen, ob inzwischen eine Ausgabe vorlag. Im schlimmsten Fall war es eine Fehlermeldung und man musste den Fehler zuerst beheben und sich dann nochmals hinten anstellen.

(Der Computer arbeitete immer nur ein Programm aufs Mal ab. Erst nach dem Ende eines Programmes konnte ein anderes gestartet werden. Ein Modus, der einigen vielleicht als Stapelverarbeitung, engl. Batch Processing bekannt ist.)

Ab den späten 1960ern gab es erste Rechner und Betriebssysteme, die mehrere Programme gleichzeitig bearbeiten konnten. Da konnte man dann schon erste Bildschirmterminals anschliessen und interaktiv arbeiten. Manche dieser Terminals waren nicht mehr wie im Bild unten direkt neben den Rechnern und ihren lauten Lüftern platziert, sondern in speziellen Terminalräumen oder auch in einzelnen Büros, teilweise ein paar 100 m vom Rechner entfernt. Für jedes dieser Terminals musste eine eigene mehradrige Leitung durch die Gebäude gezogen werden. Nicht wirklich skalierbar.

Im Verlauf der 1970er kamen erste Netzwerke auf den Markt, mit denen mehrere Rechner eines Herstellers sowie die dazu passenden Terminals auch flexibler als über Punkt-zu-Punkt-Verkabelungen verbunden werden konnten (z.B. DECnet). Auch hatten mit dem Arpanet erste US-Unis die Möglichkeit geschaffen, sich untereinander zu vernetzen, damit Forscher die Rechner von Partnerunis für gemeinsame Projekte nutzen konnten. Der Anschlussknoten für das Arpanet, der IMP (Interface Message Processor) war ein eigener Schrank, an den Rechner und manchenorts auch Terminals angeschlossen wurden, um sie untereinander zu vernetzen.

Also so ähnlich, wie wenn man heute den Rechner in den Keller stellen würde und die Tastatur und Monitor mit einem langen USB-Kabel daran angeschlossen wäre, damit man nicht immer im Keller arbeiten müsste.

Vom Einzelkabel zum Netzwerk

Solange nur ein Terminal an einem Rechner angeschlossen werden muss, ist der Aufwand für das Legen der Kabel noch übersichtlich. Ebenfalls, wenn nur wenige Terminals angeschlossen werden müssen. Sobald diese Terminals aber nahe beieinander stehen, aber weit weg vom Rechner, kommt die Frage auf, ob nicht eine gemeinsame Leitung für den gemeinsamen Weg ausreicht. Spätestens, wenn die Terminals dann auch noch auf mehrere Rechner zugreifen können sollen, steht dann definitiv die Vernetzung auf dem Plan.

So entstanden dann die ersten Netze, aber typischerweise beschränkt waren auf Geräte eines Anbieters und einen Standort der Firma.

Die Idee des Internet

Anfang der 1970er-Jahre gab es verschiedene Möglichkeiten, wie diese raumfüllenden Computer miteinander verbunden wurden:

- Direkte Kabel, wie sie auch für den Anschluss der Terminals genutzt wurden;

- angemietete Telefonleitungen zwischen den Rechnern für längere Distanzen;

- herstellerspezifische Netzwerke mit Reichweite von wenigen 100 m; und

- das Arpanet konnte via IMP und weitere Mietleitungen Rechner verbinden.

Arpanet und Internet entstanden aus drei technischen Standbeinen heraus:

- Paketvermittlung: Nicht für jede Verbindung sollte eine eigene Leitung gezogen oder angemietet werden, sondern diese Leitungen sollten von verschiedenen Systemen geteilt werden können, auch von solchen, die nicht direkt an eines der Leitungsenden angeschlossen waren, sondern über mehrere Leitungen hinweg. Dazu sollten die Datenübermittlungen in Pakete aufgeteilt werden, die unabhängig voneinander in Richtung Ziel geschickt wurden. Dazu später mehr.

- Herstellerunabhängig: Die einzelnen lokalen Netze der einzelnen Computerhersteller sollten über das Internet gekoppelt werden können. Entsprechend sollte das «Netz dazwischen» (eben, «Inter-Net») den herstellerspezifischen Protokollen möglichst wenig im Weg stehen.

- Leitungsunabhängig: Das Internet sollte – im Gegensatz zu vielen Herstellernetzen – auch unabhängig davon sein, auf welcher Art von Kabel es lief und wie die Bits auf diesen Kabeln übertragen wurden. Es sollte also über das Kabel übertragen werden können, mit dem Terminals angeschlossen wurden. Oder via Telefonleitung. Oder über die Spezialkabel, die jeder Hersteller für seine Datenübermittlung vorgesehen hatte. Und dann – aber das kam erst später – Ethernet-Kabel (und viel später Glasfasern oder WLAN). Es war aber darauf ausgelegt, über alle Technologien zu funktionieren.

Die Vision war, dass weder die darüberliegenden Herstellernetze noch die darunterliegenden Verbindungsmechanismen geändert werden müssten, sondern dass einfach zwischen Internet und den Schichten darüber oder darunter etwas Code geschrieben werden müsse.

Es kam dann aber anders: Im Laufe der Zeit sind die meisten herstellerspezifischen Rechnernetze in das Internet integriert worden und Leitungsnetze wurden so designt oder angepasst, dass sie ideal mit dem Internet zusammenarbeiten konnten.

Schlüsseltechnologien

Das Internet basiert auf mehreren Schlüsseltechnologien oder Designentscheidungen. Ohne dieses wäre es ein anderes Internet geworden, als das was wir kennen. Oder vielleicht würden wir es gar nicht (mehr) kennen, wie viele andere Netzwerktechnologien, die in den letzten Jahrzehnten entwickelt und vermarktet wurden, aber nie den Durchbruch geschafft haben oder vom Internet abgelöst wurden.

Offene Standards, offene Entscheidungen

Von Beginn an war die Entwicklung der Technologien, auf denen das Internet gebaut ist, geprägt von Offenheit. So wurden alle Designentscheidungen publiziert, alle Protokolle sind offen und damit kostenlos für alle einsehbar und nachbaubar. In vielen Bereichen ist es Voraussetzung, dass es zwei unabhängige Entwicklungsteams geschafft haben, das beschriebene Protokoll zu implementieren und dass die beiden Implementationen dann auch wirklich fehlerfrei miteinander reden konnten.

In anderen Standardisierungsgremien muss man für tausende von Franken zuerst die beschreibenden Standarddokumente kaufen, die rein am Sitzungstisch entstanden und noch nie in Software gegossen wurden. Und zusätzlich muss man möglicherweise noch einen signifikanten Prozentsatz seines Umsatzes mit den entsprechenden Produkten an Patentinhaber abgeben.

Der Entscheidungsprozess im Internet-Standardisierungsgremium, der Internet Engineering Task Force (IETF) läuft dagegen ganz anders ab. Nicht nur kann jeder Ideen einbringen, auch jeder kann die Ideen anderer kritisieren. Das Ziel ist es, am Schluss eine möglichst breite Abstützung zu haben. Oder wie es das inoffizielle IETF-Mantra ausdrückt:

We reject: kings, presidents, and voting. We believe in: rough consensus and running code.

(Wir lehnen ab: Könige, Präsidenten und Abstimmungen. Wir glauben an: Allgemeiner Konsens und laufende Programme.)

David D. «Dave» Clark, 1992

Flexibilität durch Zerstückelung in Pakete

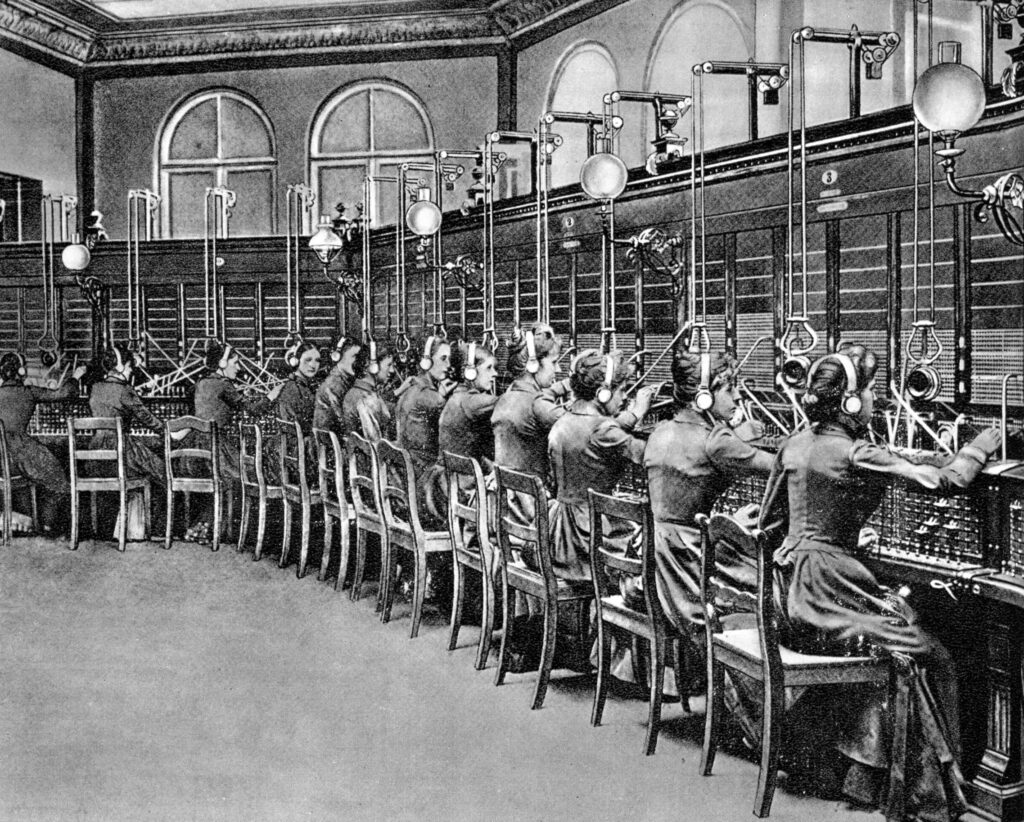

Wenn vor dem Arpanet bzw. Internet Verbindungen zwischen zwei Geräten aufgebaut werden sollten, wurden eigene Leitungen gelegt (wie oben zwischen Terminal und dem Sigma-9-Hauptrechner). Auch Telefonverbindungen funktionierten nach diesem Prinzip: Entweder wurde eine eigene Leitung zwischen den zwei Telefonen aufgebaut (z. B. zwischen Feldtelefonen) oder zu Beginn des Telefonats eine durchgehende Drahtverbindung zwischen den beiden Telefonen aufgebaut, welche während dem gesamten Telefonat bestehen blieb, auch wenn beide Parteien gerade nichts sagten. Anfänglich wurde das Erstellen dieser Kabelverbindungen von Telefonistinnen erledigt, später auch automatisch.

Ein wichtiger Schritt des Arpanet (und damit des Internet) war wegzugehen von einzelnen fix reservierten Leitungen für die Datenübertragung zwischen zwei Geräten und aus den Leitungen ein Netz aufzubauen, das dynamisch von allen Beteiligten genutzt werden konnte. Möglich machte das die Forschung von Leonard Kleinrock, der die Eigenschaften von solchen paketvermittelnden Netzen (engl. Packet Switched Networks) beschrieb. Alle Datenströme im Internet werden in kleine Pakete von rund 1 kB Grösse unterteilt und über dieses Netz zum jeweiligen Ziel gesendet.

Grundsätzlich wird jedes Paket im Internet unabhängig von allen anderen Paketen behandelt, die unterwegs sind, auch wenn sie von der gleichen Quelle zum gleichen Ziel unterwegs sind. Damit das funktionieren kann, stehen in jedem Paket Steuerinformationen, wie beispielsweise die IP-Adressen des sendenden und des empfangenden Rechners.

Der Vorteil der Paketvermittlung liegt darin, dass jeder Abschnitt der Verbindung von Quelle und Ziel nur belegt ist, wenn auch wirklich Daten zu übermitteln sind. Damit können mehrere Verbindungen dieselben Leitungen teilen, meist, ohne dass die Nutzer dies merken.

Die Unabhängigkeit der Pakete untereinander ermöglicht es, dass – sollte eine Leitung überlastet oder gestört sein – bereits das nächste Paket einen anderen Pfad zum Ziel nehmen kann, solange es einen solchen gibt.

Wie findet ein Paket den Weg zum Ziel?

Um diesen Artikel auf Ihrem Laptop (oder Tablett oder Telefon) anzeigen zu können, hat Ihr Gerät mehrere Anfragen an DNIP.ch gestellt, u. a. je eine für den Text und jedes der Bilder. Die Anfragen und die Antworten wurden in Pakete aufgeteilt und einzeln übermittelt. „DNIP.ch“ ist aber keine gültige Zieladresse für ein Paket. Deshalb hat Ihr Gerät zuerst mittels DNS herausgefunden, dass die IP-Adresse von DNIP.ch 94.237.81.241 ist (mehr dazu hier). Entsprechend wurden die Anfragen an 94.237.81.241 adressiert und der Laptop hat seine eigene IP-Adresse als Absender eingetragen, damit DNIP.ch auch weiss, wohin die Pakete mit dem Text und den Bildern zurückzusenden sind, damit der Webbrowser die Webseite mit dem Artikel auch schön darstellen kann.

Der Weg vom Laptop zu DNIP.ch und zurück läuft über viele Router (die blauen Punkte in der folgenden Grafik) und viele Leitungen dazwischen. Damit diese Router auch wissen, über welche Leitung er das Paket näher zum Ziel bringen kann, hat (vereinfacht gesagt) jeder Router für jedes mögliche Ziel einen Wegweiser aufgestellt. An jedem Router werden die dortigen Wegweiser konsultiert, bis das Paket dann schlussendlich im Ziel ist.

So weit, so gut. Doch wie kommen diese Wegweiser zu den Routern?

Wie werden die Wegweiser aufgestellt?

Stellen wir uns das frühe Internet wie ein grosses Wanderwegnetz vor. Damit man sich nicht verirrt, werden an Kreuzungen (Internet: «Router») Wegweiser aufgestellt, welche Ziele wie weit weg liegen. Um in unserem kleinen Netz allen mitzuteilen, wie lange sie zur Kreuzung («Router») A benötigen, nutzen wir folgenden Algorithmus:

- Von A aus werden entlang von allen Wegen Kundschafter ausgeschickt.

- Wenn ein Kundschafter an einer Kreuzung ankommt, stellt er einen Wegweiser auf, der Distanz und Richtung zu A angibt. Dieser zeigt in die Richtung, aus der der Kundschafter gerade gekommen ist. Bei B und G sind das die beiden «10 km»-Schilder.

- Danach fällt jeder Kundschafter die folgende Entscheidung:

- Ist der neue Wegweiser der kürzeste (oder der einzige), wird in jede Richtung, in die noch kein Wegweiser zu A existiert, ein neuer Kundschafter ausgesandt. Der Prozess geht bei Schritt 2 weiter. Dies passiert beispielsweise an den Kreuzungen B und G.

- Gibt es schon einen anderen, kürzeren Wegweiser, graut er seinen eigenen Wegweiser aus, damit der im Normalfall nicht benutzt wird. Danach geht der Kundschafter in die nahe gelegene Bergbeiz; seine Arbeit ist getan. Das passiert beispielsweise dem Kundschafter, der aus B kommend bei C eintrifft («22 km»), falls der Kundschafter aus G sein Schild bei C schon aufgestellt hat («18 km»).

Nach einigen Runden steht an jeder Kreuzung mindestens ein Wegweiser in Richtung A und an jeder Kreuzung sind alle suboptimalen Wege ausgegraut. Wenn nicht nur A, sondern auch alle anderen Kreuzungen eine entsprechende Kundschafterkette ausgeschickt haben, stehen am Schluss an jeder Kreuzung Wegweiser zu allen anderen Kreuzungen. Niemand kann sich mehr verirren.

Wer das verstanden hat, kennt die Grundlagen eines der beiden prototypischen Routingalgorithmen für Netzwerke, das Distanz-Vektor-Routing. Gratulation!

Mehr Wanderweg-Erklärungen und -Grafiken in «Filtern, sperren, abschalten: Wie sich das Internet kontrollieren lässt», für alle, die eine etwas langsamere Einführung bevorzugen oder sich noch etwas Vorwissen beschaffen wollen.

Vereinfachung durch Hierarchie und Delegation

Dieses einfache Routing funktioniert gut, solange das Netz nur aus ein paar Dutzend oder ein paar hundert Routern besteht. Sobald das Netz aber auf Zehntausende oder mehr Router wächst oder die einzelnen Internet-Provider (ISP, Internet Service Provider) sich nicht von der Konkurrenz in die Karten schauen lassen wollen, braucht es eine zweite (bzw. sogar dritte) Abstraktionsschicht:

- Auf der höheren, abstrakteren Ebene sprechen sich die ISPs (bzw. ihre Router) darüber ab, durch welche anderen ISPs ihr Netzverkehr zum Ziel gehen soll.

- Auf der Detailebene regelt jeder ISP den Verkehr nach seinem Gutdünken.

- Zusätzlich werden im Internet nicht die einzelnen Router adressiert, sondern ganze Netze mit Dutzenden, Tausenden oder sogar Millionen von IP-Adressen (die Wölkchen rechts in der Grafik unten); oft Netze ihrer Kunden. Damit existiert nochmals eine zusätzliche, implizite Ebene, auf welcher die Informationen zusammengefasst werden

Die oberste Ebene betrifft das Routing zwischen den ISPs (die farbigen Punkte im grauen Hintergrund), die mittlere Ebene das Routing innerhalb des ISPs (die hellblauen Punkte – Router – innerhalb der hellblauen Ellipse) und die unterste, implizite Ebene das Routing innerhalb des am ISP angeschlossenen Kundennetzes (die weiss-blauen Wölkchen).

(Eigentlich bezeichnen die farbigen Punkte von A-G nicht ISPs, sondern Autonomous Systems (AS). Für diese vereinfachte Erklärung hier betrachten wir die beiden Begriffe als austauschbar.)

Diese obere Hierarchieebene erlaubt ISPs auch, ihre gegenseitigen vertraglichen Beziehungen abzubilden. Die Hauptbeziehungen sind «Peering» und «Transit»:

- Peering: Direkter Datenaustausch nur zwischen den beiden beteiligten ISPs, nicht aber von Dritt-ISPs, die auch mit ihnen verbunden sind. Bei Peering verrechnen sich die beiden ISPs im Normalfall keine Kosten.

- Transit: Einer der beiden ISPs bietet an, auch Verkehr an weitere ISPs weiterzuleiten. Dafür verrechnet ersterer im Normalfall Kosten.

In der obigen Grafik könnten beispielsweise F und G nur ein Peering-Abkommen haben ohne Transit-Rechte. Deshalb bietet G seinem Nachbarn F keine Route zu A an. Die anderen Verbindungen zwischen den ISPs wären hier der Einfachheit halber Transit-Verbindungen.

C kann entscheiden, ob er Verkehr via B oder G zu A senden will. Auf dieser Ebene sind nicht notwendigerweise die Länge der Strecke bis zum Ziel relevant, sondern möglicherweise eher, welche Preise B und G für ihre Paketweiterleitungen verrechnen.

Wie ein ISP sein internes Routing abhandelt, ist alleine ihm überlassen. Zwischen den ISPs wird ein Routingprotokoll namens BGP (Border Gateway Protocol) eingesetzt, mit dem die Informationen ausgetauscht werden. Der Routingalgorithmus, mit dem die Routen ausgewählt werden, ist ähnlich dem oben beschriebenen Wegweiser-Algorithmus (Distance-Vector Protocol). Statt Distanzen in Kilometern oder anderen messbaren Metriken werden die Entscheidungen aber aufgrund von Verträgen, Kosten und vielen anderen Eigenschaften gefällt. Dies wird Policy-basiertes Routing genannt.

Die Komplexität des Routing im Internet ist nicht primär eine technische Frage, sondern vor allem eine Frage der Geschäftsbeziehungen zwischen den ISPs. Und die sind nicht immer so kooperativ, wie man sich das wünschen würde.

Kein unnötiger Aufwand

Eine der Eigenschaften, die sich durch viele Designentscheidungen im Internet zieht, ist die Vermeidung von unnötigem Aufwand. Insbesondere sollen die Router – anders als die Telefonistinnen beim Kabelstöpseln im 19. Jahrhundert (siehe Abbildung oben) – nicht Buch führen müssen über jeden einzelnen angeschlossenen Rechner oder über jede gerade laufende Verbindung. Das wären viel zu viele Informationen, die sich zudem dauernd ändern und Unmengen an Speicherplatz verschlingen würden.

Der Router wäre nur noch mit Buchführung beschäftigt, statt Pakete weiterzuleiten.

Doch genau das wurde in den 1990ern schon einmal versucht, mit einer Technologie, welche das amateurhafte, akademische Internet durch ein System mit Hand und Fuss ersetzen wollte: ATM.

ATM: Ein Versuch für ein «alternatives Internet»

In den 1990ern kam eine Konkurrenztechnologie zum Internet auf, initiiert von den Telefonfirmen, genannt ATM (Asynchronous Transfer Mode). Diese versuchte, die Ansprüche eines Telefons auf das unterliegende Netz abzubilden:

- Hörer abheben und wählen: Bevor man Daten übertragen konnte, musste man das Netzwerk bitten, eine Verbindung zum Ziel aufzubauen. Das Netzwerk legte dabei einmalig den Pfad fest («Wanderweg»), über den alle zukünftigen Daten zwischen den beiden Enden der Verbindung fliessen sollten.

- Sprachverbindung über dünnes Kupferkabel: Das von ATM am besten unterstützte Datenübertragungsmodell war das, was eine Telefonleitung nachahmte: Die zwei Enden hatten ein dünnes (bei Bedarf auch dickeres) Kabel, mit einer beim Verbindungsaufbau festgelegten konstanten, kleinen (oder grösseren) Bandbreite.

Natürlich gab es auch Unterstützung für paketorientierte Datenübertragungen oder Datenübertragung mit variabler Bandbreite. Diese fühlten sich aber im Vergleich zu «wir bauen ein Telefonnetz nach» immer irgendwie stiefmütterlich behandelt an.

ATM wurde einige Jahre lang auch für die Vernetzung von Computern eingesetzt, u.a. weil es als «professionelle» Zukunftstechnologie vermarktet wurde und mit 155 und 622 Mbit/s schnellere Datenübertragungsraten als die damals verwendeten 10- und 100-Mbit/s-Ethernet-Netze versprach.

U.a. durch die einfachere und günstigere Zugänglichkeit zu IP- und Ethernet-Technologie und -Know-How gewann dann doch das Internet die Oberhand, auch ausserhalb der akademischen Umgebung. Ein weiterer gewichtiger Unterschied: Das Internet versuchte zu vermeiden, dass jeder Router jederzeit über alle die durch ihn hindurch laufenden Verbindungen im Detail informiert war. Dies vereinfachte die Technologie und viele Anwendungen und sorgte für einfachere und günstigere Umsetzung, auch weil damit die Lösung des schwierigen Problems der Zustandssynchronisation in verteilten Systemen vermieden werden konnte.

Übrigens: Der Reload-Button im Browser („Seite neu laden“, ↻) ist eine Auswirkung davon, dass in realen verteilten Systemen eine unter allen Umständen immer zuverlässige Synchronisation des Zustandes zwischen zwei (oder mehr) Systemen beweisbar unmöglich ist. Mit dem Reload-Knopf wird der Server nochmals um seinen aktuellen Zustand gebeten.

Wir würden gerne aus den Fehlern lernen

In den 1990ern begann das Internet über die Universitäten hinaus zu wachsen. Es war klar, dass dieses Wachstum mit aus dem kooperativen Elfenbeinturm heraus zusätzliche Herausforderungen mit sich bringen würde. Das damalige Internet-Protokoll in Version 4 («IPv4», die Versionsnummern davor gibt es übrigens nicht) sollte grundlegend renoviert werden.

Man wollte also – analog vom Schritt vom Arpanet zum Internet – einen Schritt zum Nachfolger des Internet, dem «Internet der nächsten Generation» («Next Generation Internet Protocol», «IPng») in Angriff nehmen. Dabei sollten u.a. folgende Problemfelder angegangen werden:

- Zu wenige Adressen: Die Adressen in IPv4 waren 32 Bit lang, was in den 1970ern als mehr als ausreichend angesehen worden war. Da einige Adressbereiche Sonderfunktionen hatten, waren nur ca. 3½ Milliarden Adressen nutzbar, infolge von sehr hohem Verschnitt war aber nur ein Bruchteil davon nutzbar. Es war abzusehen, dass auch mit flankierenden Massnahmen schon in wenigen Jahren zu wenige IP-Adressen für alle am Internet angeschlossenen Geräte zur Verfügung stehen würden.

- Fehlende Sicherheit: Weder Verschlüsselung noch Schutz vor Veränderungen durch Dritte war im Internet vorgesehen. Passwörter wurden beim Login auf andere Systeme im Klartext übermittelt, jeder mit Zugang zur Leitung konnte diese Passwörter sammeln. Auch andere vertrauliche Daten waren nicht geschützt. Dies war keine Basis für Datenschutz und Datensicherheit.

- Keine effiziente Datenverteilung: Falls Daten an viele Empfänger übermittelt werden sollten, beispielsweise für Fernsehen via Internet, mussten die Daten für jeden Empfänger separat vom Server des Senders aus übermittelt werden. Damit war klar, dass der Internetanschluss des Senders schon bei wenigen gleichzeitigen Zuschauern überlastet sein würde.

- Keine Bandbreitenreservation: Damit Datenverbindung, über die Live-Fernsehen, Video-on-Demand oder Telefon- bzw. Videokonferenzen laufen sollten, ohne Ruckeln, Stottern oder Aussetzer ankämen, wollte man die Reservation von Bandbreite ermöglichen.

- Fehlende Erreichbarkeit unterwegs: Wenn man das Gerät vom Büro nach Hause nimmt, hat es nachher eine andere IP-Adresse. Bestehende Verbindungen werden abgebrochen, das Gerät ist auch für neue Verbindungen nicht mehr unter der alten Adresse erreichbar. (WLAN und Internet via Mobilfunk waren damals erst Träume.)

- Automatische Konfiguration der Netzwerkparameter: IP-Adresse und weitere Informationen sollten neu automatisch vergeben werden. Auch ohne manuelle Konfiguration oder zentralen Server sollten Geräte im gleichen Netzwerk so miteinander kommunizieren können.

Aufgrund dieser Bedürfnisse und erster Versuche wurde beschlossen, diese IPng-Wünsche im neuen IPv6 umzusetzen:

- Längere Adressen mit 128 Bit

- Vereinfachung und Modularisierung des Paketformats

- Vereinfachung der Routingmechanismen zur Verkleinerung des Aufwands rund um Routing (Aufstellen der Wegweiser) und Paketweiterleitung (Forwarding, Folgen der Wegweiser)

- Einbau von IPsec direkt ins Internetprotokoll, mit dem alle Verbindungen automatisch verschlüsselt werden können und die Authentizität des Pakets mit Inhalt garantiert wird

- Globale Nutzungsmöglichkeit für Multicast, eine Technik, mit der ein Paket effizient an mehrere Empfänger gleichzeitig geschickt werden kann

- Unterstützung von wählbarer Dienstqualität (QoS, Quality of Service) u.a. zur Bandbreitenreservierung

- Mobile IP, damit man seine IP-Adresse auch unterwegs dabei haben kann

- Automatische Konfiguration der Netzwerkparameter und Ankündigung von Diensten im lokalen Netz

Clevere, effiziente Lösungen gibt es

Für alle diese Mechanismen wurden in den 1990ern bis Anfangs der 2000er clevere, skalierbare Technologien entwickelt. Dabei wurde auch Rücksicht darauf genommen, dass Router – insbesondere die grossen, teuren Geräte im Internet-Backbone – einen langsameren Update-Zyklus haben als Software auf den Endgeräten und im Vergleich zu den übermittelten Daten wenig Rechen- und Speicherkapazität haben.

Trotzdem werden sie kaum eingesetzt

Trotzdem: Inzwischen sind 30 Jahre vergangen und in vielen Firmen ist IPv6 immer noch ein Fremdwort. Auch wenn man ein Cloudangebot nutzt, also etwas vom modernsten und vor allem durch Software definiert, ist in vielen Fällen das Standardnetzwerk, welches intern genutzt wird, IPv4-basiert. (Nach aussen wird trotzdem oft auch IPv6 angeboten.)

Wenn wir das Internet heute anschauen, sehen wir – zumindest als Endkunde – kaum Probleme mit der Verfügbarkeit von IP-Adressen; unsere Rechner konfigurieren sich automatisch; sie arbeiten im Büro, daheim und unterwegs, solange sie Netzzugang haben; die meisten Verbindungen sind verschlüsselt; wir können tagsüber Videokonferenzen abhalten und abends fernsehen oder streamen, meist ohne Ruckler.

Wir haben eigentlich alle Probleme gelöst, die IPng lösen wollte. Einfach auf ganz andere Weise:

- NAT (Network Address Translation): In unserem lokalen Netzwerk daheim oder im Büro oder unterwegs werden andere Adressen genutzt als im globalen Internet. Dazu werden zwischen unserem lokalen Netzwerk und dem Internet die Absender- bzw. Empfängeradressen umgeschrieben; Dutzende bis Tausende Geräte teilen sich – von aussen her gesehen – eine IP-Adresse.

- ZeroConf auch in IPv4: Mittels Techniken wie DHCP und Multicast-DNS (mDNS) funktionieren lokale Netze auch, ohne dass die Nutzerin bei jedem Netzwerkwechsel mehrere Konfigurationsdateien auf ihrem Rechner ändern muss.

- Overlaynetze: Wenn mehrere Geräte eine sichere Verbindung untereinander aufbauen wollen, beispielsweise zwischen Heim- und Firmennetz, kommen VPN zum Einsatz (Virtual Private Network). Diese bauen ein privates Netz nur für die beteiligten Rechner auf, unabhängig davon, wo die Rechner wirklich stehen und ob und wie sie miteinander verkabelt sind.

- TLS (Transport Layer Security), wie es beispielsweise bei HTTPS-Verbindungen zum Einsatz kommt, stellt sicher, dass die Daten auf dem Weg zum Ziel nicht von unberechtigten Dritten gelesen oder verändert werden können.

- CDN (Content Delivery Network): Firmen wie Akamai, Netflix, Amazon, Microsoft, Google oder CloudFlare haben überall auf der Welt verteilt Server verteilt. Wenn man nun Daten von diesen Firmen anfragt (Webseiten, Videos, …) werden sie nicht von einem zentralen Server möglicherweise am anderen Ende der Welt ausgeliefert. Stattdessen stammen die Daten von einem oder mehreren Servern, die Kopien der beliebtesten Daten nahe den Kunden aufbewahren, sodass die Daten nur einen kurzen Weg nehmen müssen. Dadurch werden Netze weniger überlastet und Überlastungen an anderen Stellen in der Welt wirken sich weniger auf uns aus.

Was war passiert?

Backbone: Das Internet besteht aus Hunderttausenden von Routern im Besitz von Tausenden von ISPs. Insbesondere in den 1990er-Jahren war die Hardware der Router wichtiger, nur Teile der Funktionen konnten sich effektiv in Software abbilden lassen. Bei den High-End-Modellen kamen Spezialchips zur Anwendung, die nicht einfach so ersetzt werden konnten. Änderungen bedingten deshalb nicht nur die Verfügbarkeit der neuen Protokolle und von Software, welche diese umsetzte, sondern auch von Hardware und der Unterstützung der Hardware-Hersteller. Einige dieser frühen Umsetzungen waren mit Problemen behaftet, was die ISPs nicht motivierte, die Zuverlässigkeit ihrer Infrastruktur für entsprechende «experimentelle» Änderungen aufs Spiel zu setzen.

Heimuser: Ähnliches spielte sich auch bei den Heimroutern der Enduser ab. Zusätzlich waren diese User oft weder in der Lage, ihre Router zu konfigurieren noch IPv6 auf ihren Rechnern einzuschalten.

ISP: Aber auch die ISPs selbst hatten oft nicht die Ressourcen oder den Willen, sich mit IPv6 zu beschäftigen. Und solange die User nicht da waren, gab es auch keinen Grund dazu. Ganz besonders, da der Westen (im Gegensatz zum Osten und dem Globalen Süden) schon reichlich mit IPv4-Adressen ausgestattet war und da wenig Druck herrschte. Und ohne Druck der User fehlte die Motivation, «jetzt schon» Geld zu investieren.

Neue Produkte und Dienstleistungen: Gleichzeitig begannen IT-Firmen, mit neuen Funktionen ihrer Produkte (NAT, ZeroConf, VPN, TLS) und neuen Dienstleistungen (VPN, CDN) Angebote zu machen für diejenigen, welche (a) von den Problemen betroffen waren und (b) bereit waren, für eine schlüsselfertige Lösung zu bezahlen. Diese Innovationen drangen dann auch in den Massenmarkt durch und lösten die Probleme auf Applikations- statt auf Internetebene.

| Technik | Nachteile | Vorteile |

|---|---|---|

| NAT | Rechner von Nutzerinnen können nicht mehr direkt miteinander reden, nur noch via Clouddienste Gewisse Protokolle hatten Probleme damit (z. B. FTP) Bei mehrstufigem NAT (also auch der Provider macht nochmals NAT, genannt CGNAT) wird zusätzlich die Möglichkeit, einzelne eigene Ports und Dienste zu öffnen, vollständig verhindert. | Kann lokal eingesetzt werden, keine Abhängigkeiten von Änderungen im restlichen Netz |

| Adress-Autokonfiguration (Teil von ZeroConf) | Die eigenständige Adressvergabe braucht länger Keine gleichzeitige Nutzung von eigenständigen (lokalen) und vom Router vergebenen Adressen (Unterbruch beim Routerausfall) | |

| VPN | In seiner verbreitesten Form unnötige Umwege und zusätzliche Netzwerkbelastung | |

| TLS | Metadaten immer noch sichtbar und manipulierbar (nur Daten selbst sind geschützt) | |

| CDN | Jeder Anbieter muss selbst seine Infrastruktur aufbauen |

Schlussfolgerung

Das Internet entstand als minimalistische Lösung zur Verbindung zwischen verschiedenen Rechnern. Dieser Minimalismus war der Schlüssel, damit das Internet einfach blieb und den bestehenden Technologien kein unpassendes Betriebsmodell aufgedrückt werden musste, wenn sie eingebunden wurden.

Dadurch hatte es einfache, verlässliche Eigenschaften, war stabil und universell einsetzbar und «gut genug» für fast alle Anwendungen. Selbst (grundsätzlich) einfach, aber flexibel einsetzbar.

Es ist so flexibel, dass man darauf fast beliebe Anwendungen umsetzen kann. Es ist auch so zuverlässig, da es meist bei Ausfällen alternative Wege um die Ausfallstelle herum gibt. Und wenn die Zuverlässigkeit nicht reicht, legt man halt sein eigenes Kabel in den Boden. Aber auch das findet der Bagger genau dann, wenn er es nicht sollte.

Die Stabilität des Internet bezieht sich auch darauf, wie schwierig es ist Änderungen im Netz und seinem Protokoll durchzuführen. Seine Flexibilität hat es aber auch erlaubt, überall Verbesserungen umzusetzen, so dass das Internet auch 50 Jahre später mit einer Million mal mehr verbundenen Rechnern, viel höherer Bandbreite und vielen anderen Anwendungen immer noch das beliebteste Netzwerk ist. Und es wird uns als Gemisch zwischen IPv4 und IPv6 noch lange begleiten.

Um es mit Churchill zu sagen: Das Internet ist das schlechteste Netzwerk, das man sich vorstellen kann; abgesehen von allen anderen, die von Zeit zu Zeit ausprobiert worden sind.

Das Internet ist wie die Schweiz

In der Einleitung habe ich versprochen, dass das Internet sei wie die Schweiz. Hier einige Punkte, die das offensichtlich machen.

- Drei Männer – J. C. R. Licklider, Bob Kahn und Leonard Kleinrock – hatten das Internet auf der grünen Wiese gegründet. (Es gäbe auch noch andere Männer und später sehr wichtige Frauen. Aber hey, es geht um den Vergleich.)

- Es ist stabil. Änderungen brauchen ihre Zeit, falls sie überhaupt je durchkommen.

- Es ist föderiert, wie wir am hierarchischen Routing erkennen. Jeder kann ein bisschen selber entscheiden, sich aber auch an gemeinsame Regeln halten.

- Es ist grundsätzlich demokratisch, wie man an der Organisation des Internet-Standardisierungsgremiums IETF sieht. Auch wenn mehr Geld schon auch etwas ausmacht.

- Manchmal ist es besser, einen Tunnel zu benutzen, wenn man von A nach B will. Dies zeigt sich in den VPN-Tunneln und allen anderen Overlaynetzen und ihren Tunneln.

- Es ist die Drehscheibe für alles, was Geld abwirft. Auch für die weniger ethischen Seiten der Menschheit.

- Die grossen Probleme werden nicht mit radikalen Änderungen gelöst. Aber manchmal ist das auch gut genug.

Fühlt sich doch richtig schweizerisch an, nicht?

Weiterführende Literatur

- Living Internet: Internet History

Viele frühe Entwicklungen sind hier dokumentiert. - System Development Corporation (PDF) (Wikipedia)

Eine der frühen Arpanet-User - J.A. Payne: ARPANET Host to Host Access and Disengagement Measurements (PDF), NTIA Report 78-3, 1978-05.

Inklusive geographischer und logischer Arpanet-Karten von 1977 - Pim van Pelt, Jeroen Massar: SixXS.net (ausgesprochen Six-Access), Archiv der Webseite von 2017.

Versuch, IPv6-Zugang als Overlay-Netz für Endkunden aufzubauen, solange ihre eigenen ISPs noch kein IPv6 unterstüzten. Beschreibt auch das Henne-Ei-Problem von IPv6. - James Marinero: Starlink Outage Leaves US Naval Drones Adrift: Insights into Satellite Dependence, 2026-04-19.

Nicht nur Glasfasern können angebaggert werden, auch Satellitennetze können ausfallen.

3 Kommentare

Nachdem „NAT“ für Privatanwender völlig normal geworden ist (und gerne auch mal mit Firewall verwechselt wird, weil unangeforderte Datenpakete von aussen abgelehnt werden), ist der neue Hype „CGNAT“ (aka Carrier Grade NAT). Da bekommt der Kunde des ISP zwar eine IPv4 Adresse, diese liegt aber in einem offiziell privaten Netzwerk wie 10.0/16 (wird also öffentlich nicht geroutet), somit kann der Kunde damit kein VPN von unterwegs nach Hause machen. Häufig passiert dies in Kombination, keine IPv6-Adresse zuzuteilen 🙁

Ein ISP, der mir via CGNAT meine „WAN“-Adresse zuteilt würde ich sofort wechseln.

Ich verstehe immer noch nicht, warum IPv6 so ein Schattendasein fristet und mindestens im öffentlichen Internet nicht längst zur Selbstverständlichkeit geworden ist.

Hier eine Übersicht basierend auf Nutzerberichten, Foren und Provider-Angaben (die Situation kann je nach Tarif, Region, Anschlussart und Zeitpunkt variieren – immer selbst prüfen!):

• Salt (ehemals Salt Fiber / Salt Box): Salt setzt CGNAT bei vielen (oder den meisten) Festnetz-Anschlüssen ein. Die WAN-IP des Routers ist dann privat (z. B. 10.12.x.x). Port-Forwarding funktioniert nicht ohne Workaround. Lösung: Für ca. 10 CHF/Monat kann man eine öffentliche (statische oder dynamische) IPv4-Adresse buchen. Bei älteren Verträgen gibt es manchmal Grandfathering. Viele Nutzer berichten, dass Salt besonders aggressiv mit CGNAT umgeht.

• Init7 (Easy7-Tarif): Der günstigere Easy7-Tarif basiert bewusst auf IPv6 + CGNAT (mit vorkonfigurierter FRITZ!Box). Er eignet sich für einfache Surf-Nutzung, nicht für Server, VPN-Server oder Port-Forwarding. Besserer Tarif: Fiber7 (teurer) bietet normale öffentliche IPv4-Adressen ohne CGNAT. Hybrid7 (auf Swisscom-Infrastruktur) hat oft ebenfalls keine CGNAT.

• Swisscom (teilweise): Swisscom verwendet CGNAT nicht flächendeckend, aber bei manchen (vor allem neueren oder bestimmten) Festnetz-Anschlüssen und vor allem bei Mobilfunk (SIM-Karten). Viele Kunden haben noch eine echte öffentliche IPv4, besonders bei älteren oder Business-Tarifen. Es gibt Berichte, dass Swisscom Anschlüsse auf CGNAT umgestellt hat. Opt-out oder eine öffentliche IP ist oft per Support möglich.

• Sunrise (inkl. ehemals UPC / Yallo / Galaxus Internet etc.): Sunrise setzt CGNAT nicht standardmässig oder nur bei bestimmten Tarifen/Regionen ein. Viele Nutzer berichten von öffentlichen IPv4-Adressen. Bei Kabel- oder Fiber-Anschlüssen ist es meist möglich, eine echte IP zu haben (manchmal auf Anfrage). Allerdings gibt es vereinzelte Berichte über CGNAT bei günstigen oder Hybrid-Tarifen.

• Andere / kleinere Provider:

• Wingo (Swisscom-basiert): Oft keine CGNAT, eigene Router möglich.

• Leucom (regional, z. B. Thurgau): Nutzt explizit CGNAT, um IPv4 zu sparen.

• Mobile Anbieter (Swisscom, Salt, Sunrise Mobile): Fast immer CGNAT bei privaten Mobilfunk-Tarifen.

• Reseller oder Wholesale-basierte Anbieter (z. B. über Swisscom BBCS): Können je nach Reseller variieren.

Danke für die CGNAT-Übersicht. Ja, CGNAT hatte ich ganz vergessen. Uups! (Jetzt hinzugefügt.)

Ich bin glücklicherweise bei einem regionalen ISP mit statischer IP-Adresse und einem IPv6-/56-Subnetz (könnte also nochmals 256 öffentlich routbare Netze einrichten).