Deepseek hat die bis dato bekannte «KI-Ordnung» mächtig ins Wanken gebracht. Kolumnist Reto Vogt ist überzeugt, dass Europa aus dem Rennen zwischen den USA und China etwas lernen muss.

Seit der Veröffentlichung von Deepseek hat sich das Narrativ in Rekordzeit verschoben. Plötzlich stehen nicht mehr OpenAI oder Google für den grössten Fortschritt im Bereich Künstliche Intelligenz, sondern eine chinesische KI. Für mich sind auch rund zwei Wochen nach dem Release des aktuellen Modells noch viele Fragen offen: Wie war das möglich? Was bedeutet das für den globalen KI-Wettlauf? Ist Deepseek ein Einzelfall oder erst der Anfang? Und vor allem: Stimmt das alles, was die Chinesen behaupten?

Fakt ist: Die amerikanischen KI-Unternehmen sind nervös. Meta hat «Warrooms» eingerichtet, in denen Spezialistinnen und Spezialisten dem Geheimnis von Deepseek auf den Grund gehen sollen. Und OpenAI beschuldigt das chinesische Unternehmen – oh welch Ironie – seine Daten gestohlen zu haben, um das Modell zu trainieren. Und Chiphersteller Nvidia hat quasi über Nacht 600 Milliarden Dollar an Börsenwert eingebüsst. Mittlerweile erholt sich der Aktienkurs zwar wieder, aber der Verlust ist beispiellos.

Inhalte

ToggleWie war das (so günstig) möglich?

Im Zentrum dieser Geschehnisse steht vor allem eine Frage: Wie konnte Deepseek mit so viel weniger Geld eine vergleichbare KI entwickeln? Angeblich soll das Unternehmen dieselbe Leistungsfähigkeit wie ChatGPT mit einer Investition von lächerlichen sechs Millionen Dollar und ohne die leistungsfähigsten Nvidia-Chips erreicht haben. OpenAI & Co. haben das Zigfache davon investiert.

Die Stanford University liefert eine Vergleichsbasis: Laut AI Index kostete das Training von OpenAIs GPT 4 gut 80 Millionen Dollar. Und Google investierte ins Training von Gemini Ultra mit rund 191 Millionen Dollar nochmal mehr Geld. Aufgrund dieser Zahlen bin ich skeptisch, dass Deepseek korrekte Zahlen nennt. Nur sechs Millionen Dollar? Das klingt fast zu absurd, um zu stimmen.

Vier Erklärungsversuche

- Die Zahl ist schöngerechnet. Vielleicht wurden nur die reinen Trainingskosten angegeben – ohne die Forschung, die Infrastruktur oder das Pre-Training.

- China hatte versteckte Ressourcen. Die Regierung hat KI zur Priorität erklärt und könnte Deepseek subventioniert oder auf nicht-öffentliche Datenquellen zurückgegriffen haben.

- Die Architektur ist radikal effizienter. Falls Deepseek wirklich ein Modell mit deutlich weniger Rechenleistung trainieren konnte, wäre das ein technologischer Quantensprung.

- Oder, und auch das ist aufgrund der geopolitischen Situation nicht unwahrscheinlich: Peking steuert das Narrativ bewusst, um die Wall Street und Big Tech in den USA zu destabilisieren.

Welche der genannten Möglichkeiten zutrifft, weiss ich nicht. Vielleicht ist es eine Mischung aus allen vieren. Vielleicht stimmt auch keine davon.

Die korrekten Zahlen werden wir wohl nie erfahren – China ist nicht für Transparenz bekannt. Das macht es schwer bis unmöglich, Fakten von Propaganda zu trennen. Und genau so verhält sich auch die KI selbst. Informationen, die nicht ins offizielle Narrativ passen, verschwinden schnell. Nach Fragen zu Tibet oder dem Tiananmen-Massaker möchte der Chatbot lieber über etwas anderes «sprechen» – zumindest bei klassischen Konversationen. Wer das Open-Source-Modell auf eigener Hardware selbst betreibt, erhält ungefilterte Antworten. Das zeigt vor allem eines: Die Trainingsdaten waren nicht zensiert, es handelt sich um ein direktes Eingreifen von den Machthabern in Peking.

Zensur von Deepseek sollte Augen öffnen

So komisch es klingt: Das ist nicht nur schlecht. Vielleicht helfen die Lügen von Deepseek, dass KI-Tools nun bewusster genutzt werden. Dies, weil viele User plötzlich lernen: Aha, eine KI kann auch Mist erzählen. Schliesslich ist jede KI biased. Und keine KI ist der Wahrheit verpflichtet, sondern bestenfalls der Wahrscheinlichkeit – und schlimmstenfalls der voreingenommenen Daten, mit denen sie trainiert worden ist.

Wer glaubt, dass westliche KI-Modelle neutral und objektiv sind, hat nicht verstanden, wie sie funktionieren. Die Frage ist nicht, ob wir einer KI vertrauen können, sondern ob wir bereit sind, sie als das zu akzeptieren, was sie ist: Ein simples Werkzeug, dem nicht blind vertraut werden darf, egal ob es aus China oder den USA stammt.

Europa muss selbst mitspielen, sonst bleibt es Statist

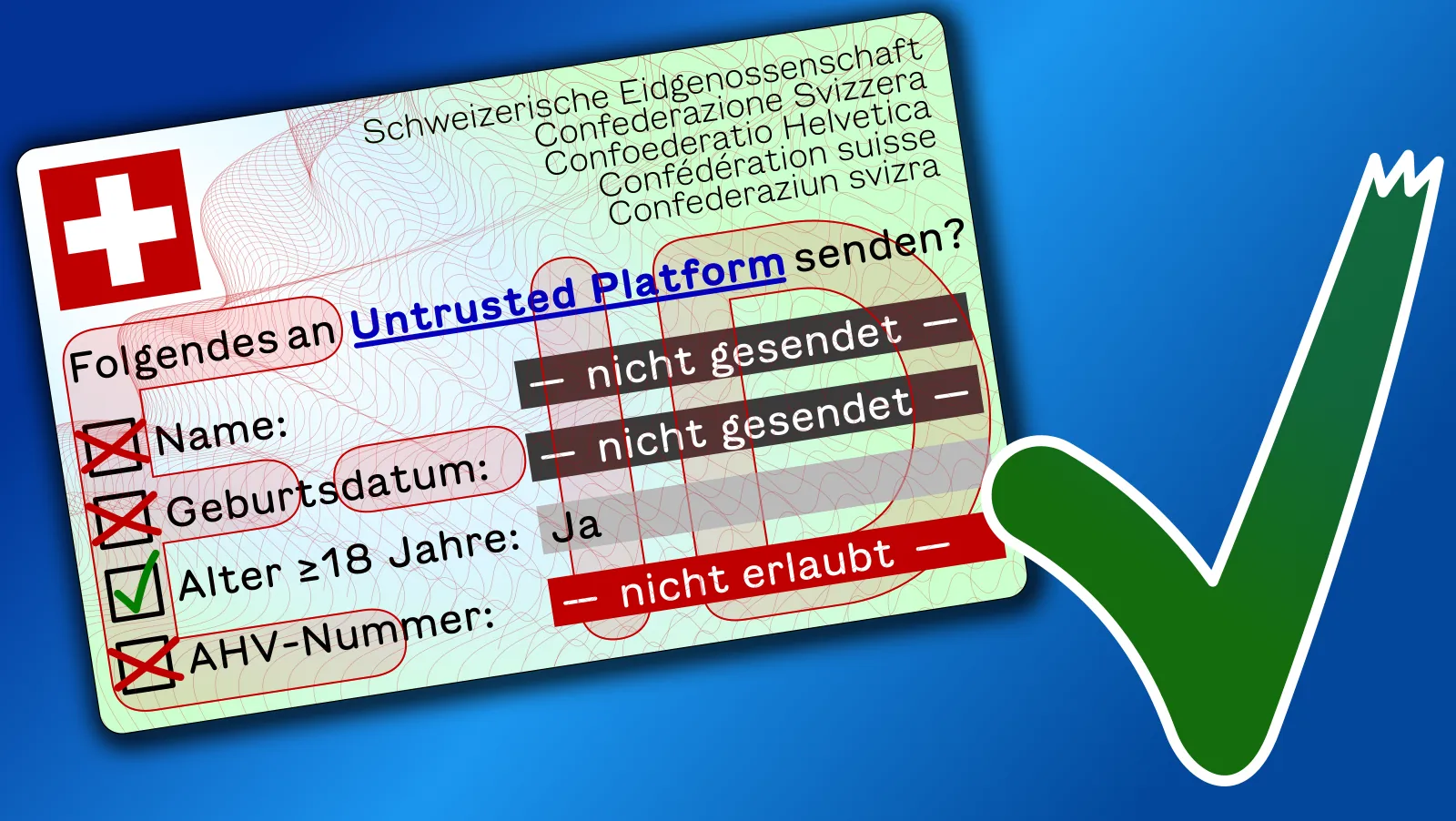

Abschliessend führt uns die Debatte um die KI-Vorherrschaft vor Augen, dass Europa diesbezüglich nur eine Zuschauerrolle einnimmt. Dabei wären die Voraussetzungen – durch die Regulierung und durch unsere hervorragenden Hochschulen – für eine vertrauenswürdige, menschenrechtszentrierte Künstliche Intelligenz gegeben. Ich finde: Europa kann sich nicht auf ethische Standards und Governance allein verlassen – es muss auch selbst mitspielen. Wer die Regeln bestimmt, ohne das Spiel zu beherrschen, bleibt ein Statist.

Deepseek zeigt, dass sich das KI-Rennen beschleunigt hat – und dass die Startgebühr womöglich günstiger ist, als bisher angenommen. Doch vorerst bleibt Europa in der Zuschauerrolle und hält sich lieber an seine drei Prinzipien: Glaube an die Regulierung, Liebe zur Bürokratie und die Hoffnung, dass sich ethische Standards irgendwann von selbst in technologische Innovation verwandeln. Ob das reicht, um mitzuspielen, bezweifle ich.